Neue digitale Werkzeuge ermöglichen auch neue Forschungsmethoden. Ökologinnen und Ökologen nutzen Kamerafallen mit Bewegungsmeldern (motion triggers), um Wildtiere zu beobachten. Dabei setzen sie immer häufiger auf machine learning, um die grossen Datenmengen zu analysieren. Die Videoinstallation Triggered by Motion dokumentiert diesen Prozess.

Bis in die 1990er-Jahre gab es nur zwei Möglichkeiten, um Wildtiere zu erforschen: Entweder wurden Individuen gefangen, untersucht, markiert und wieder freigelassen – oder die Forscherinnen und Forscher beobachteten vor Ort. Im Gegensatz dazu lassen sich Tierpopulationen mit Kamerafallen beobachten, ohne zu invasiven Mitteln wie Halsbändern oder Ohrenmarken greifen zu müssen und ohne deren Verhalten zu beeinflussen.

Unauffällig und kompakt: Kamerafalle im Hantan River Crane Observatory. (Abbildung: Center for Anthropocene Studies, KAIST)

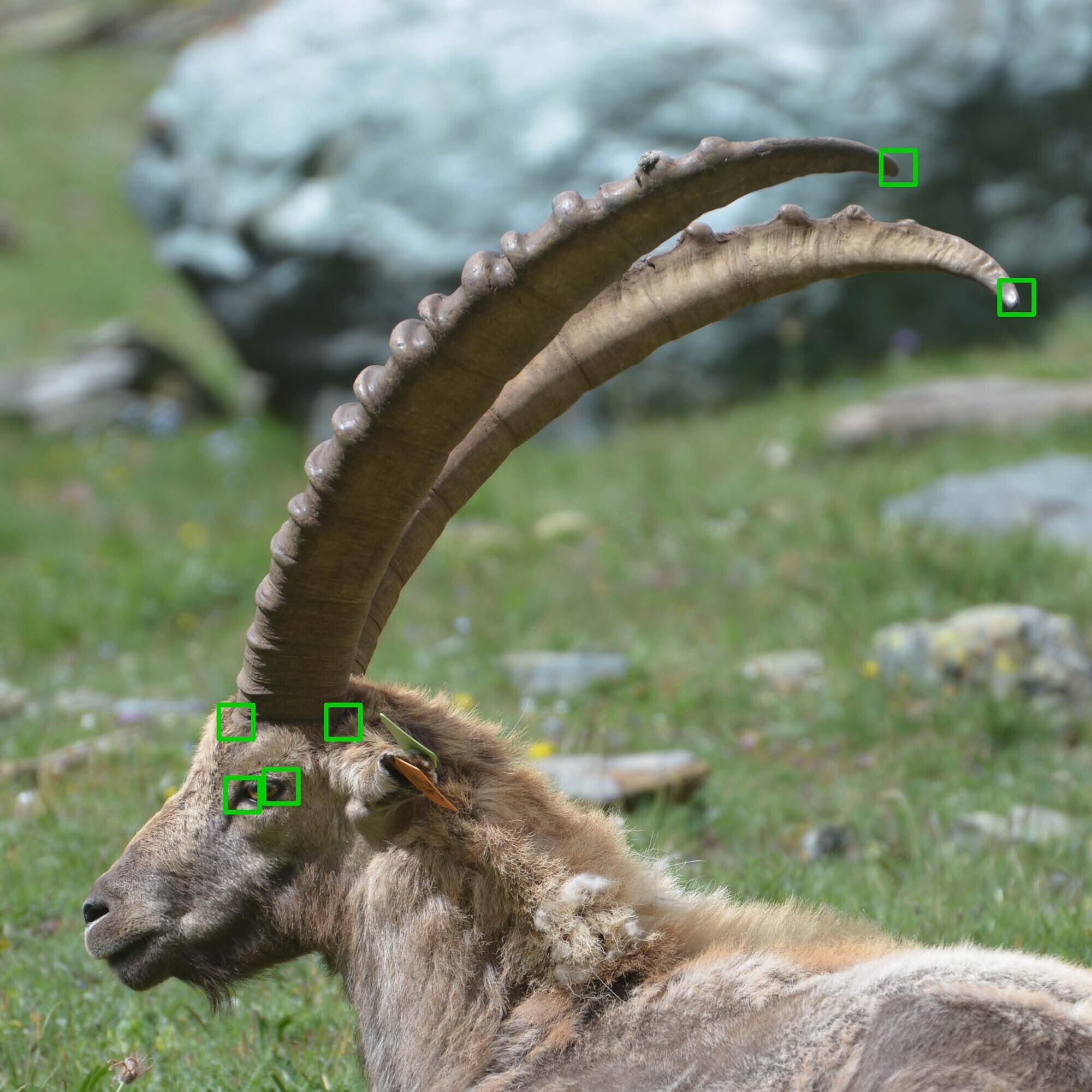

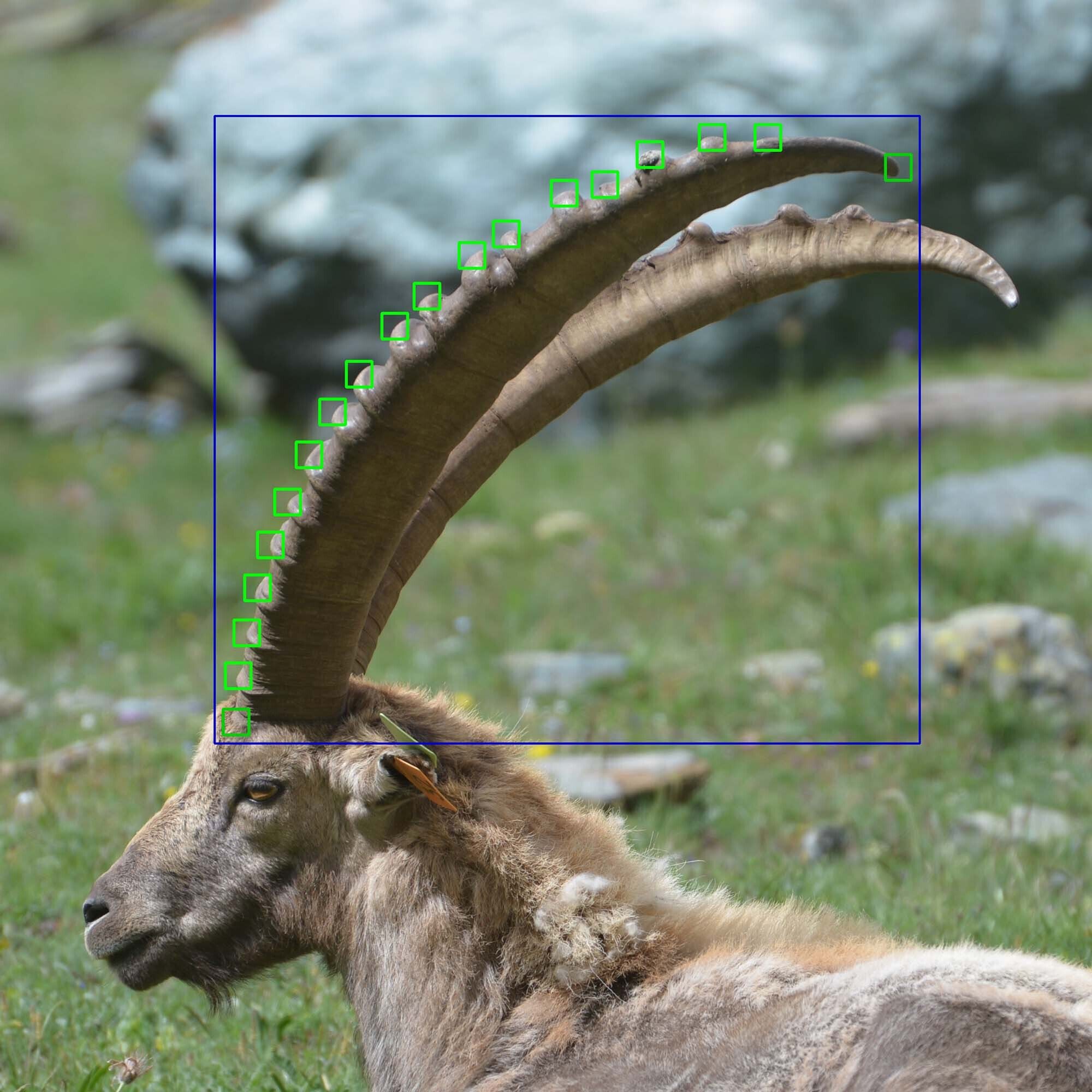

Allerdings generieren diese Kameras riesige Datenmengen, die manuell sortiert werden müssen, was sehr zeitaufwendig ist. Hier soll künstliche Intelligenz Abhilfe schaffen: Zurzeit wird intensiv an Methoden geforscht, die sich maschinelles Lernen zunutze machen, um die Bildauswertung zu beschleunigen. Neben KI für einzelne Spezies wie Kraniche (Südkorea, demilitarisierte Zone), Wildhunde (Botswana, Okavango-Delta) oder Steinböcke (Italien, Nationalpark Gran Paradiso) geht es dabei auch um projektübergreifende Algorithmen, die auf immer mehr Tierarten anwendbar sein sollen.

Die Anforderungen an die Forscherinnen und Forscher sind also hoch und setzen meist interdisziplinäre Zusammenarbeit voraus. Die Videoinstallation Triggered by Motion fungiert in diesem Kontext als Netzwerkforum: Über Online-Meetings, Vorträge, Webinare und lebhafte Debatten hat die Arbeit an der Installation Forscherinnen und Forscher aus den Bereichen Wildtierforschung, Naturschutz und Bild-/Videodatenanalyse aus der ganzen Welt zusammengeführt und interessante neue Ideen und Initiativen hervorgebracht. Triggered by Motion soll diesen Prozess nun in eine breitere Öffentlichkeit tragen. Denn die Zukunft des digitalen Naturschutzes sieht zwar vielversprechend aus – aber Naturschutzprojekte funktionieren nur, wenn sie auch ausserhalb der Fachcommunity mitgetragen werden.

Im Rahmen des Ibex Project werden Steinböcke anhand bestimmter Orientierungspunkte (sog. landmarks) identifiziert. (Abbildung: Alice Brambilla)

Für die Installation wurden in 21 Naturschutzprojekten weltweit ein ganzes Jahr lang Videodaten gesammelt, synchronisiert und zu 20-minütigen Filmen verarbeitet. So offenbaren die Filme in dem begehbaren Pavillon die globalen Rhythmen zwischen Tag, Nacht und den Jahreszeiten.

Mehr Informationen zu den Kamerafallen finden Sie auf unserer interaktiven Karte.

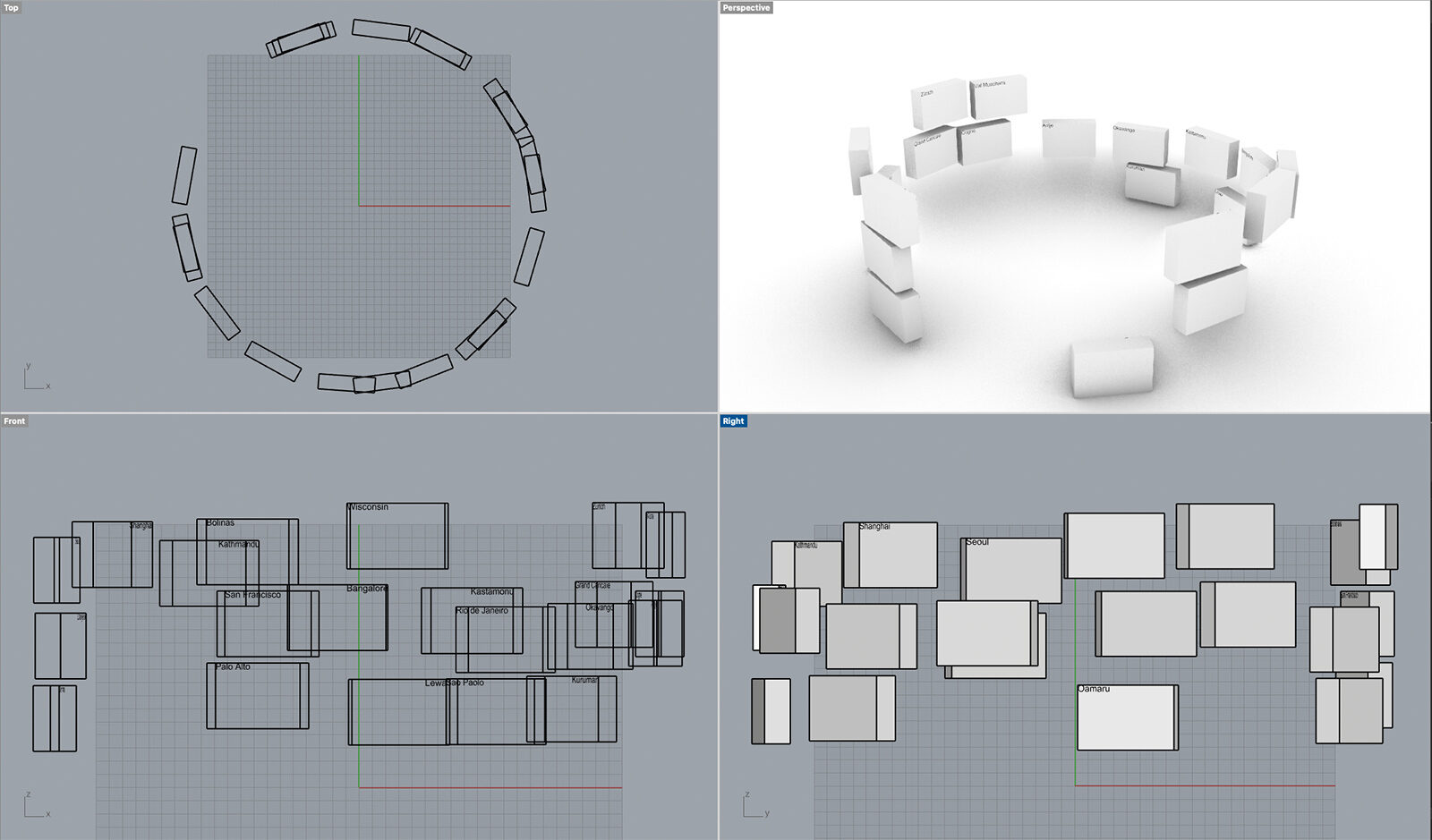

Der Pavillon folgt einem parametrischen Design und besteht aus insgesamt 1547 unterschiedlichen Einzelteilen. Die Anordnung der Bildschirme im Inneren folgt der geografischen Verteilung der Kamerastandorte. Sie bilden die Parameter für das Design des Pavillons, den Dino Rossi in Grasshopper, einer algorithmus-basierten, visuellen Programmiersprache, entworfen hat. Die Produktion der Einzelteile verdanken wir der Schweizer Firma Impact Acoustic, die hohe Ansprüche an Funktionalität und Design mit einem konsequenten Engagement für die Nachhaltigkeit kombinieren: Der Pavillon von Triggered by Motion besteht aus einem speziellen, schalldämmenden Material, für das rund 33'000 Einweg-Plastikflaschen upgecyclet wurden.

Ein Blick hinter die Kulissen: Aufbau und Design des Pavillons. (Abbildungen: Frank Brüderli und Dino Rossi)

Maschinelles Lernen und insbesondere künstliche Intelligenz sind heute viel verwendete Begriffe. Sie zu erklären ist aber gar nicht so einfach. Was Intelligenz ist, ist eine philosophische Frage und künstliche Intelligenz entsprechend schwer zu definieren. Maschinelles Lernen hingegen lässt sich besser eingrenzen: Es beschreibt Computerprogramme oder Algorithmen, die sich durch Erfahrung ständig verbessern, also lernen. Machine-Learning-Algorithmen sind insofern eine bestimmte Form von künstlicher Intelligenz, als dass sie kognitive Fähigkeiten des menschlichen Gehirns imitieren.

Geprägt wurden beide Begriffe in den 1950er-Jahren, als sich Digitalcomputer mit beständig wachsenden Rechenleistungen in Forschungseinrichtungen verbreiteten. Ab den 1980er-Jahren fanden sie Eingang in immer mehr Disziplinen. Seit einigen Jahren sind sie auch in der Ökologie angekommen. Die Open-Source-Plattform LINC (Lion Identification Network of Collaborators), ist ein gutes Beispiel dafür, wie machine learning in der Ökologie heute genutzt werden kann – auch das Team um Dominic Maringa in Kenia, das am Projekt Triggered by Motion beteiligt ist, verwendet sie.

Die relative Häufigkeit der Begriffe «machine learning» und «artificial intelligence» seit 1970. In der Grafik wird auch der erste KI-Boom in den 1980er-Jahren ersichtlich. (Abbildung: Google Ngram Viewer)

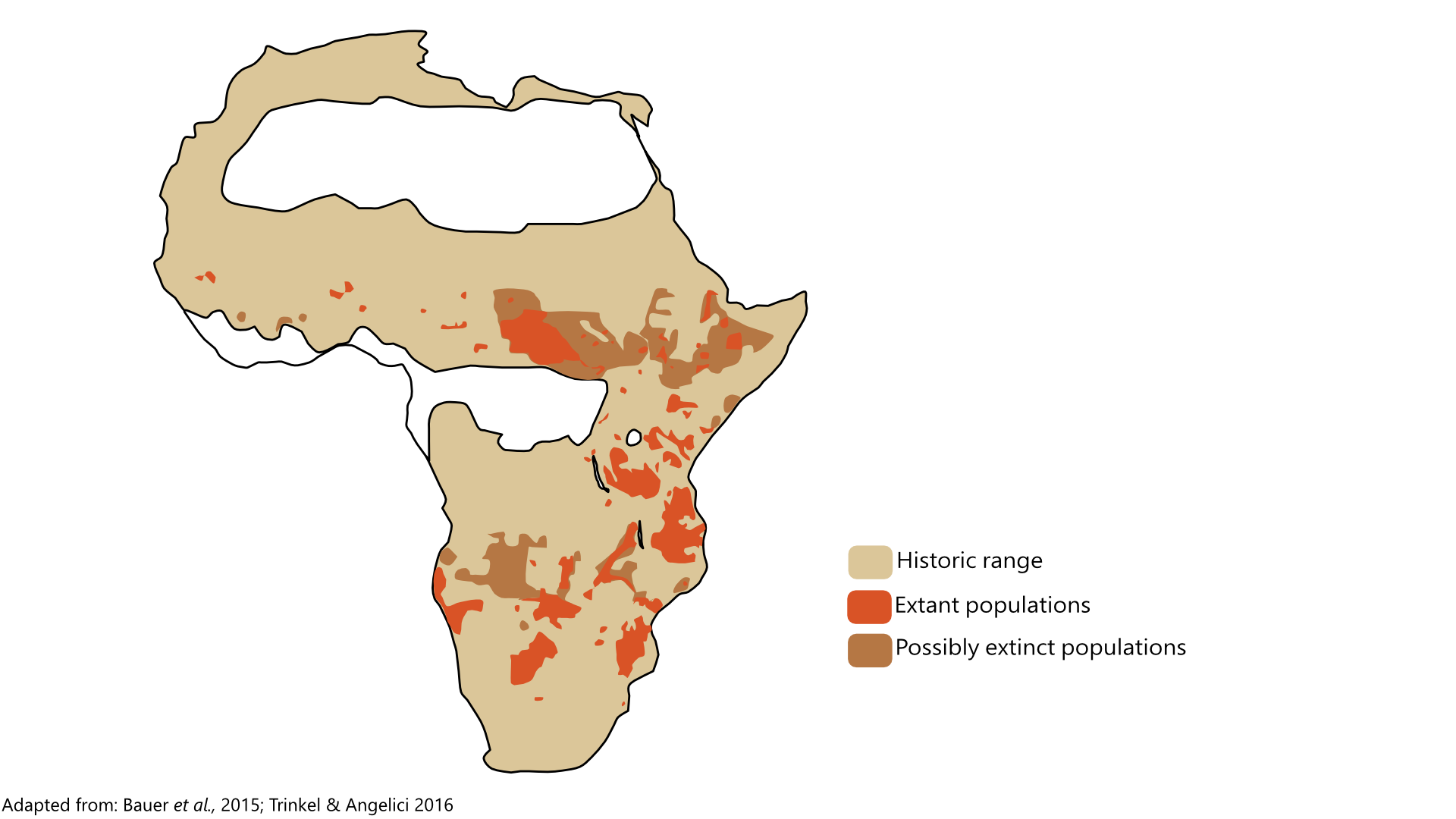

LINC soll die Erforschung und Erhaltung der Löwenpopulationen auf dem afrikanischen Kontinent vereinfachen, indem es die Zusammenarbeit zwischen Institutionen und über Ländergrenzen hinweg fördert. Das ist dringend nötig, denn seit der Jahrtausendwende hat der Afrikanische Löwe 42 Prozent seines Lebensraums verloren. Die einzelnen Populationen wurden deshalb zunehmend voneinander isoliert. Um die genetische Vielfalt der Tiere zu erhalten und so zu verhindern, dass Populationen wegen Inzucht aussterben, ist es wichtig, das Wanderverhalten der Löwen zu kennen. Die Daten, die über LINC gesammelt werden, sollen sichtbar machen, in welchen Gebieten sich die Tiere grösstenteils aufhalten und wann und wie sie in andere Gebiete migrieren.

Das Gebiet der heutigen Löwenpopulationen (rot) besteht nur noch aus Bruchteilen der ursprünglichen Verbreitungszone (hellbraun). In vielen weiteren Gebieten (dunkelbraun) ist der Afrikanische Löwe vermutlich bereits ausgestorben. (Abbildung: © LINC)

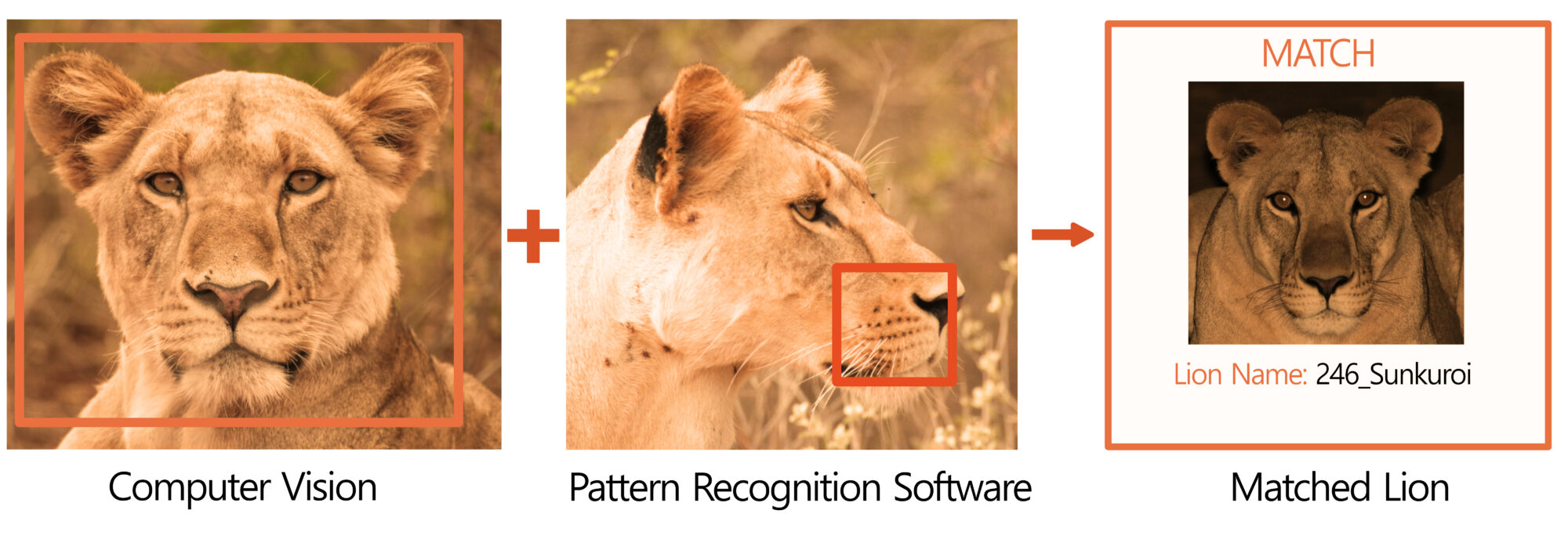

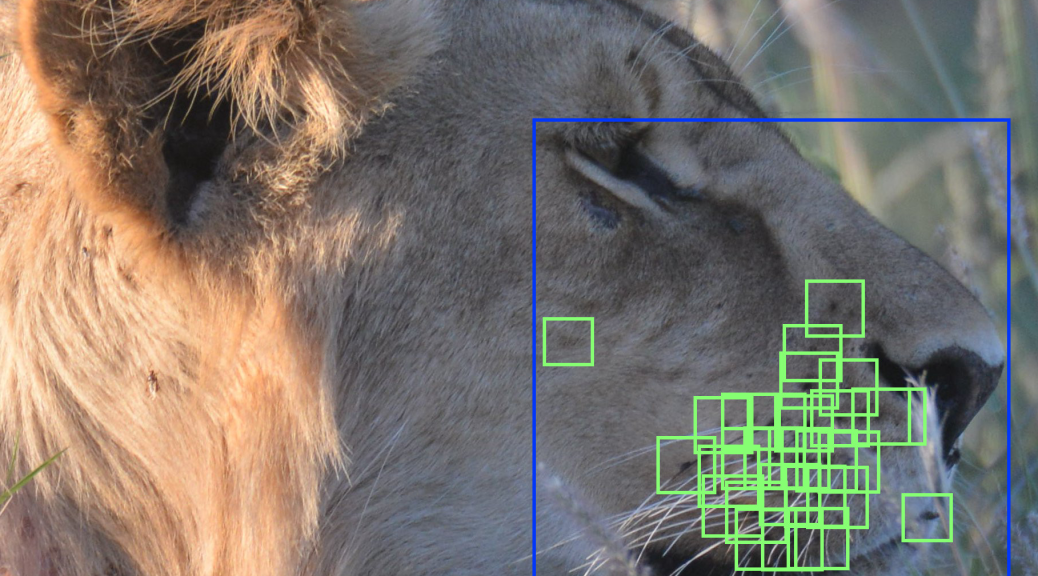

Das wiederum setzt voraus, dass die Bewegungen einzelner Löwenindividuen verfolgt werden können. Diesen Part übernehmen Machine-Learning-Anwendungen: Sie können die einzelnen Tiere anhand bestimmter Gesichtsmerkmale wie etwa der Augenform erkennen und identifizieren. Aber wieso wird hier auf selbstlernende Algorithmen gesetzt? Wäre es nicht einfacher, einen Algorithmus zu programmieren, der von Anfang an alle nötigen Informationen hat, anhand derer er die Löwenindividuen identifizieren kann?

Denken Sie einmal an Ihre engsten Freundinnen und Freunde. Ihre Gesichter zu erkennen, fällt Ihnen wahrscheinlich nicht schwer. Wenn Sie nun aber in Worte fassen müssen, woran genau Sie sie unterscheiden können, stossen Sie wahrscheinlich bald an Ihre Grenzen – spätestens dann, wenn Sie dieses Gedankenspiel auf Ihren gesamten Bekanntenkreis ausweiten. Das gleiche Problem stellt sich bei den Löwengesichtern von LINC. Anders formuliert: Wie lässt sich eine nicht vollständig in Worten ausformulierbare kognitive Fähigkeit – die Fähigkeit, Gesichter zu erkennen – in eine für den Computer verständliche Sprache übertragen?

Die Antwort ist enttäuschend: Es ist nicht möglich, weil uns Menschen dazu sowohl die Beobachtungsgabe als auch die sprachlichen Mittel fehlen. Und genau deshalb soll der Computer selbst zu unterscheiden lernen.

Im Fall von LINC wird der Computer zunächst mit Beispielbildern von Löwenindividuen gefüttert. Das ist mühsame Handarbeit: Forscherinnen und Forscher fotografieren einzelne Löwen aus verschiedenen Blickwinkeln, geben jedem Tier eine Nummer und schreiben jedes Foto entsprechend an. Diese Beispielbilder werden dann in die Machine-Learning-Anwendung eingespeist. Zu Beginn entscheidet der Algorithmus rein zufällig, ob er auf zwei Bildern dasselbe Tier erkennt oder zwei verschiedene. Diese Entscheidung gleicht er dann mit der richtigen Lösung ab. Das wiederholt er Tausende Male mit einer Vielzahl unterschiedlicher Bilder, und mit jedem Mal vergrössert sich seine Erfahrung und damit die Trefferquote.

Schritt für Schritt bildet der Algorithmus auf diese Weise die Kategorien selbst, anhand derer er die Löwenindividuen identifizieren kann, und wird immer zuverlässiger. Ähnlich wie ein Baby, das mit der Zeit die Gesichter seiner Verwandten erkennt, lernt die Anwendung so Muster und Gesetzmässigkeiten zu erkennen, ohne dass Programmiererinnen und Programmierer jedes Kategorisierungsmerkmal bestimmen und in den Algorithmus festschreiben müssen.

Zusätzlich zur Gesichtserkennungs-Software wird bei LINC das Muster der Schnurrhaare abgeglichen. Der Vergleich ähnelt dem von Fingerabdrücken und erhöht die Genauigkeit der Zuordnung. (Abbildung: © LINC)

Auf ähnliche Weise kommt machine learning auch in weiteren Projekten zum Einsatz, die an Triggered by Motion beteiligt sind. In Botswana etwa identifiziert Gabriele Cozzis Team afrikanische Wildhunde anhand ihrer Fellmuster; in Südkorea entwickeln Choi Myung-Ae und ihr Team einen Algorithmus, der Kraniche nach Arten sortieren und zählen kann; und das Ibex Project im italienischen Nationalpark Gran Paradiso tüftelt an einer KI, die einzelne Steinböcke erkennen kann.

Dieser Wildhund konnte durch sein individuelles Fellmuster identifiziert werden. Der Algorithmus lokalisiert als erstes das Tier im Bild und gleicht dann das Fellmuster mit einer Datenbank ab. (Abbildung: African Carnivore Wildbook / Botswana Predator Conservation Program)

Die Algorithmen sind nicht perfekt: Wenn sich die Wildhunde zum Beispiel im Schlamm gewälzt haben oder die Kraniche an nebligen Tagen zu weit entfernt an der Kamerafalle vorbeifliegen, haben die Systeme Mühe, die Tiere korrekt zu erfassen. Trotzdem erleichtert machine learning die Forschung enorm und wird in Zukunft weiter an Bedeutung gewinnen. Netzwerkforen wie LINC und Triggered by Motion helfen dabei, Forscherinnen und Forscher miteinander zu verbinden und die Technologie so voranzutreiben.

Projektteam:

Leitung: Dr. Katharina Weikl, Graduate Campus, UZH

Assistenz: Manuel Kaufmann, Graduate Campus, UZH

Projektmanagement: Leila Girschweiler (bis August 2021), Anne-Christine Schindler (ab September 2021), Graduate Campus, UZH

Computational Biology: Laurens Bohlen, Graduate Campus, UZH

Pavillon-Design: Dino Rossi, Impact Acoustic

CNC Operator: Dimitri Zehnder, Impact Acoustic

Mentorin: Prof. Dr. Ulrike Müller-Böker, Graduate Campus, UZH

Wissenschaftlicher Beirat: Prof. Dr. Daniel Wegmann, Universität Freiburg

Schnitt: Jan-David Bolt, Vanessa Mazanik, Lars Mulle, Vanja Tognola, Hadrami Yurdagün

Sound-Design: Lars Mulle

Bildbearbeitung Postkarten: Sebastian Lendemann

Mit herzlichem Dank an Impact Acoustic für die Produktion des Pavillons mit Material aus recyceltem PET.

Forschungs- und Kooperationspartner:innen:

Afrika

Kuruman River Reserve, Südafrika: Marta Manser, Brigitte Spillmann, Universität Zürich, Zoe Turner, Kalahari Research Centre

Lewa Wildlife Conservancy, Kenia: Dominic Maringa, Eunice Kamau, Timothy Kaaria, Lewa Wildlife Conservancy, Martin Bauert, Zoo Zürich

Moremi Game Reserve, Botswana: Gabriele Cozzi, Universität Zürich, Megan Claase, Peter Apps, Botswana Predator Conservation Trust

Asien

Chennai, Indien: Susy Varughese, Vivek Puliyeri, IIT Madras

Cheorwon, Südkorea: Choi Myung-Ae, Center for Anthropocene Studies, KAIST

Kastamonu, Türkei: Anil Soyumert, Alper Ertürk, Universität Kastamonu, Dilşad Dağtekin, Arpat Özgül, Universität Zürich

Seoul, Südkorea: Kim Gitae, Citizen Scientist

Shanghai, China: Li Bicheng, Naturhistorisches Museum Shanghai

Europa

Cerova, Serbien: Mihailo Stojanovic, Citizen Scientist

Engadin, Schweiz: Hans Lozza, Schweizerischer Nationalpark

Fanel, Schweiz: Stefan Suter, WLS.CH / ZHAW

Nationalpark Gran Paradiso, Italien: Alberto Peracino, Parco Nazionale Gran Paradiso, Alice Brambilla, Universität Zürich

Zürich, Schweiz: Conny Hürzeler, Citizen Scientist, Madeleine Geiger, StadtWildTiere Zürich

Nordamerika

Bolinas, USA: Jeff Labovitz, Suzan Pace, Citizen Scientists

Palo Alto, USA: Bill Leikam, Urban Wildlife Research Project

Rolling WI, USA: Blayne Zeise, Jennifer Stenglein, Snapshot Wisconsin / USFWS Pittman-Robertson Wildlife Restoration Program

San José, USA: Yiwei Wang, Dan Wenny, SFBBO Coyote Creek Field Station

Ozeanien

Oamaru, Neuseeland: Philippa Agnew, Oamaru Blue Penguin Colony

Südamerika

Pedregulho, Brasilien: Rita de Cassia Bianchi, Rômulo Theodoro Costa, São Paulo State University

Rio de Janeiro, Brasilien: Natalie Olifiers, Cecília Bueno, Beatriz Elvas, Universidade Veiga de Almeida / Wild Vertebrate Study Center NEVS

Entwickelt wurde das internationale Netzwerk mit Unterstützung von: swissnex San Francisco, swissnex Brazil, swissnex Boston, swissnex China, swissnex India, Swiss Science & Technology Office Seoul und der Schweizer Botschaft in Nairobi.